Einführung in Azure AI Services, Teil 2 Bildklassifizierung über das Azure KI Vision SDK mit C#

Anbieter zum Thema

Azure AI Vision ist eine künstliche Intelligenz, die es Softwaresystemen ermöglicht, visuelle Eingaben durch die Analyse von Bildern zu interpretieren. In diesem kleinen Tutorial wollen wir den Service zur Analyse genauer betrachten.

In Microsoft Azure stellt der „Azure AI Vision“-Dienst vorgefertigte Modelle für gängige visuelle Aufgaben bereit, einschließlich der Analyse von Bildern zum Vorschlagen von Bildunterschriften und Tags sowie der Erkennung gängiger Objekte und Personen. Der Dienst lässt sich unter anderem auch dafür verwenden, den Hintergrund von Bildern zu entfernen oder ein Thumbnail aus dem für das Bild relevanten Inhalt zu generieren.

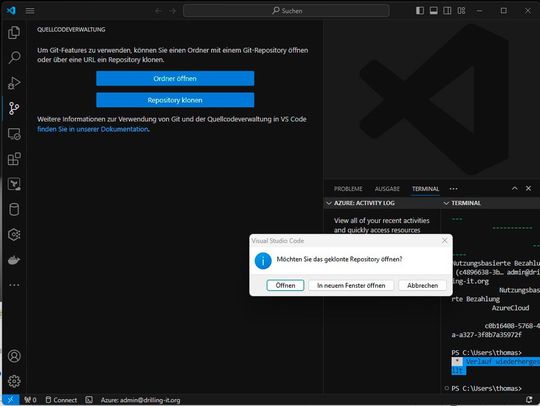

Für dieses Beispiel nutzen wir Visual Studio Code, über das sich Microsofts GitHub-Learn-Repository für AI-Vision bequem klonen lässt. Als Ziel dient ein beliebiger Ordner auf dem Rechner. Anschließend ist es möglich, das geklonte Repository lokal zu öffnen.

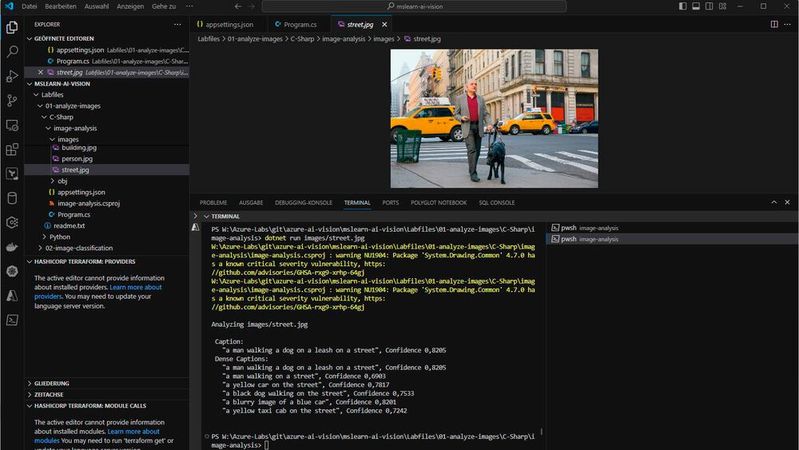

In folgendem Beispiel stellen wir eine bereits teilweise implementierte Client-Anwendung aus dem genannten Repository fertig, welche das Azure AI Vision SDK zum Analysieren von Bildern verwendet. Das SDK kann wahlweise in C# oder Python verwendet werden, wir verwenden C#.

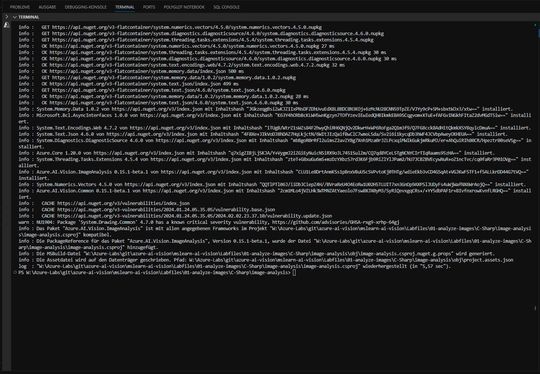

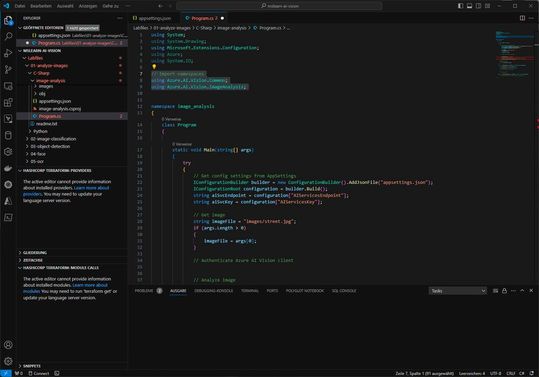

Zunächst navigieren wir in Visual Studio Code im Explorer-Bereich zum Ordner „Labfiles/01-analyze-images“ und erweitern den Ordner „C-Sharp“. Es folgt ein Rechtklick auf den Ordner „image-analysis“, um diesen mit „in Integriertem Terminal öffnen“ im VS-Code-Terminal zu öffnen. Nun installieren wir das Azure AI Vision SDK-Paket für C# mit …

dotnet add package Azure.AI.Vision.ImageAnalysis -v 0.15.1-beta.1

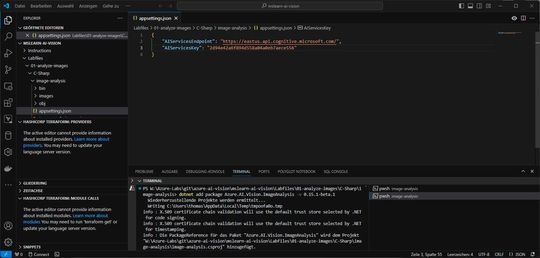

Der Ordner enthält für C# eine JSON-Konfigurationsdatei „appsettings.json“. Wir aktualisieren die darin enthaltenen Konfigurationswerte mit den Angaben zu „Endpunkt“ und einen „Authentifizierungsschlüssel“ der verwendeten „Azure AI Services“-Ressource und speichern die Anpassungen.

Der Ordner enthält auch eine Code-Datei „Program.cs“ mit einer Client-Demo-Anwendung. Wir öffnen die Code-Datei und suchen oben unter den vorhandenen Namespace-Referenzen den Kommentar „// Import namespaces“. Hier gilt es, folgende Codezeilen hinzuzufügen, um die für die Verwendung von Azure AI Vision SD benötigten Namespaces zu importieren. Anschließend speichern wir die Datei.

using Azure.AI.Vision.Common;

using Azure.AI.Vision.ImageAnalysis;

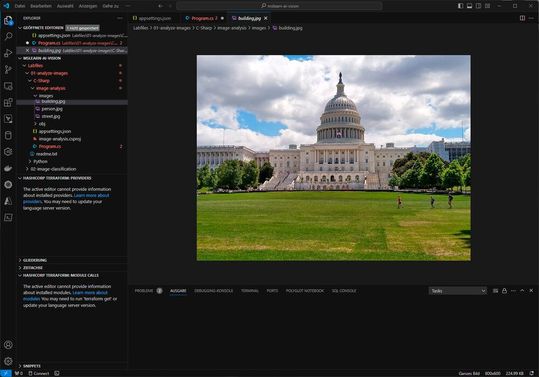

In diesem Beispiel nutzen wir den Dienst „Azure AI Vision“ zum Analysieren von Bildern. Wir erweitern in Visual Studio Code den Ordner „image-analysis“ und den darin enthaltenen Ordner „images“, der drei Bilder enthält. Wichtig ist zu prüfen, ob die Bilder korrekt in VS Code angezeigt werden.

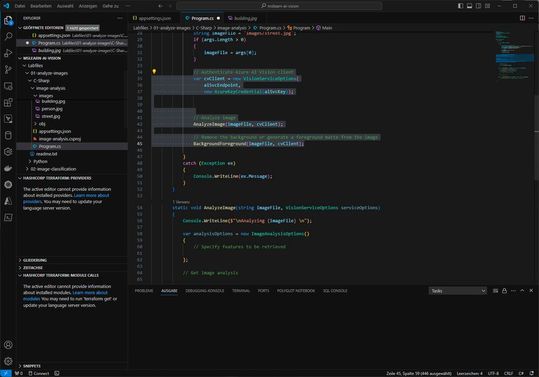

Jetzt ist es möglich, das SDK zu verwenden, um den Vision-Dienst aufzurufen und ein Bild zu analysieren. In der Code-Datei für die Client-Anwendung (Program.cs) muss sichergestellt sein, dass über die Main-Funktion der Code zum Laden der Konfigurationseinstellungen bereitgestellt wurde. Unter dem Kommentar …

// Authenticate Azure AI Vision client… fügen wir das folgende Code-Segment hinzu:

var cvClient = new VisionServiceOptions(

aiSvcEndpoint,

new AzureKeyCredential(aiSvcKey));

Hier gilt es zu beachten, dass der Code in der Main-Funktion unterhalb des soeben hinzugefügten Codes den Pfad zu einer Bilddatei angibt – und diesen dann an zwei weitere Funktionen („AnalyzeImage“) und („BackgroundForeground“) übergibt, die zum gegenwärtigen Zeitpunkt noch nicht vollständig implementiert sind.

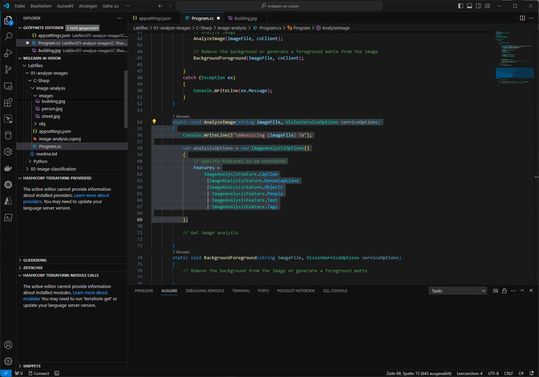

Innerhalb des vorbereiteten Rumpfs der Funktion „AnalyzeImage“ fügen wir unter dem Kommentar „// Specify features to be retrieved“ folgenden Code hinzu:

Features =

ImageAnalysisFeature.Caption

| ImageAnalysisFeature.DenseCaptions

| ImageAnalysisFeature.Objects

| ImageAnalysisFeature.People

| ImageAnalysisFeature.Text

| ImageAnalysisFeature.Tags

Außerdem erweitern wir innerhalb des vorbereiteten Rumpfs die Funktion „AnalyzeImage“ unter dem Kommentar „//Get images analysis“ um folgenden Code:

// Get image analysis

using var imageSource = VisionSource.FromFile(imageFile);

using var analyzer = new ImageAnalyzer(serviceOptions, imageSource, analysisOptions);var result = analyzer.Analyze();if (result.Reason == ImageAnalysisResultReason.Analyzed) {

// get image captions

if (result.Caption != null) { Console.WriteLine(" Caption:");

Console.WriteLine($" \"{result.Caption.Content}\", Confidence {result.Caption.Confidence:0.0000}");

} //get image dense captions

if (result.DenseCaptions != null) {

Console.WriteLine(" Dense Captions:");

foreach (var caption in result.DenseCaptions) { Console.WriteLine($" \"{caption.Content}\", Confidence

{caption.Confidence:0.0000}");

}

Console.WriteLine($"\n");

} // Get image tags

// Get objects in the image

// Get people in the image

}

else {

var errorDetails = ImageAnalysisErrorDetails.FromResult(result);

Console.WriteLine(" Analysis failed.");

Console.WriteLine($" Error reason : {errorDetails.Reason}");

Console.WriteLine($" Error code : {errorDetails.ErrorCode}");

Console.WriteLine($" Error message: {errorDetails.Message}\n");

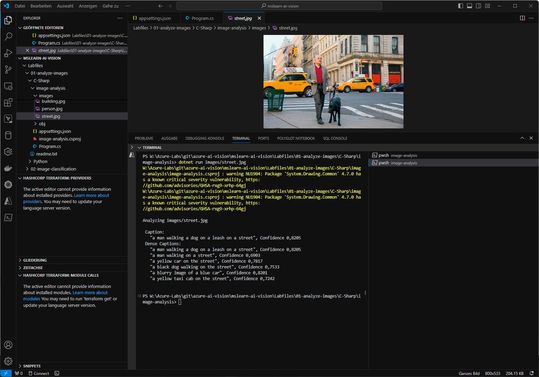

Nach dem Speichern der Änderungen kehren wir zum integrierten Terminal für den Bildanalyse-Ordner zurück und geben den folgenden Befehl ein, um das Programm z. B. mit dem Argument „images/street.jpg“ aus diesem Ordner auszuführen:

dotnet run images/street.jpgVoraussetzung ist, dass die erforderliche .NET-7-Runtime installiert ist. Das Ergebnis sollte etwa so aussehen, wie im vorherigen Bild. Alle Code-Fragmente stammen wie oben erwähnt aus Microsofts frei zugänglichem Learn-Repository für AI-Vision.

Dieses kleine Beispiel dient in erster Linie als Anregung für weitere Experimente. Auf der verlinkten Seite finden sich auch noch weitere Code-Beispiele, z. B., um bestimmte Einzel-Objekte innerhalb eines Bildes zu lokalisieren und zu identifizieren oder Personen in einem Bild zu erkennen.

Wir werden in nächsten Teil dieser kleinen Serie demonstrieren, wie Programmierer und Programmiererinnen die KI-Funktionen nutzen können, um den Vordergrund eines Bildes automatisiert freizustellen.

(ID:49923832)

:quality(80)/p7i.vogel.de/wcms/c8/6b/c86bfadc9400e3859e5a8173b99872db/0114956871.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/e2/82e20061fab6f1fc0561f023c6bfd2cc/0114109627.jpeg)

:quality(80)/p7i.vogel.de/wcms/5f/f4/5ff47683e4bc8de6cf2d484e627c58f2/0107845613.jpeg)

:quality(80)/p7i.vogel.de/wcms/55/d8/55d8de7a538dd09179a73c8038cf4147/0107796204.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/dc/80dc01258b6dda1e7b216323d5796051/0118518397.jpeg)

:quality(80)/p7i.vogel.de/wcms/b5/92/b592b98f6fa8f4d5393e7d1f26a9b1ab/0117932513.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/88/af88b8b06a9613b86559b6999ef4ed8a/0118097195.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/b3/8eb34e2abe20465041e396063e8d39b5/0118088468.jpeg)

:quality(80)/p7i.vogel.de/wcms/d8/59/d859a4bcea4e775772b78767789646e7/0117717484.jpeg)

:quality(80)/p7i.vogel.de/wcms/4a/3d/4a3d398f19b8fa2044a3a9f0081e46f2/0118416942.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/39/9939f3b5fdaae42f3bf4ac2465270f2a/0117791750.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/9d/f19deb033fc3094112887ccba347e548/0118171860.jpeg)

:quality(80)/p7i.vogel.de/wcms/65/3b/653bccb0f4511868163e35e79ef17efe/0118315737.jpeg)

:quality(80)/p7i.vogel.de/wcms/c8/75/c87528ebc7bd0be79bf5b009d07822da/0117952488.jpeg)

:quality(80)/p7i.vogel.de/wcms/97/dd/97ddc917ccc52db20fcb3cbdebe916f1/0118360337.jpeg)

:quality(80)/p7i.vogel.de/wcms/bd/f1/bdf1217cc5885d60e2eac54ad9a69e26/0117073864.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/da/17dafb2a1af44f861d791dda292b219b/0118430756.jpeg)

:quality(80)/p7i.vogel.de/wcms/5b/85/5b853b09ae4f974cb97b58e5cb8e759b/0118249571.jpeg)

![Mithilfe eines anderen Konsensverfahrens, Hashgraph, ließe sich eine Menge CO2 bei der Berechnung von Kryptowährungen sparen. (Bild: Benjamin ['O°] Zweig - stock.adobe.com) Mithilfe eines anderen Konsensverfahrens, Hashgraph, ließe sich eine Menge CO2 bei der Berechnung von Kryptowährungen sparen. (Bild: Benjamin ['O°] Zweig - stock.adobe.com)](https://cdn1.vogel.de/annR7MKBLjg3UGu-x3l6Nvb7-fI=/288x162/smart/filters:format(jpg):quality(80)/p7i.vogel.de/wcms/4e/40/4e40e5356b18ebce4656f2a51e65c815/0116079923.jpeg)

:quality(80)/p7i.vogel.de/wcms/01/d0/01d02743d019010886e4fe0d47222d72/0115628204.jpeg)

:quality(80)/p7i.vogel.de/wcms/7a/59/7a595755b165e6d0939b52bc4bb82e9d/0113646230.jpeg)

:quality(80)/p7i.vogel.de/wcms/be/18/be18ae4c02dbf9aa47e97decf9b84ea4/0118091847.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/ba/afba059e1e635289905bc63ce8cc4579/0117149678.jpeg)

:quality(80)/p7i.vogel.de/wcms/79/8a/798ac0bb2a4e3a384a3c7634dc919ceb/0117709235.jpeg)

:quality(80)/p7i.vogel.de/wcms/ef/83/ef83b21f59d76ece1f76070d93e9bd6b/0116763715.jpeg)

:quality(80)/p7i.vogel.de/wcms/c2/21/c2213857722c33ef3d02db0acf33abc0/0112236476.jpeg)

:quality(80)/p7i.vogel.de/wcms/a9/6d/a96d15ff02a35fc84a9b65702395aa6b/0110694349.jpeg)

:quality(80)/p7i.vogel.de/wcms/ce/c1/cec146c6f112e79b71c56d37ee27145e/0105884802.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/65/68/656863dbcf3d9/logo-devops-windhoff-group.png)

:quality(80)/p7i.vogel.de/wcms/87/82/8782383e42eb0482bcf02d2e26a39053/0116489594.jpeg)

:quality(80)/p7i.vogel.de/wcms/06/7c/067c581355ca6b67d9478dcc22984ef0/0112164588.jpeg)